VLLM配置

本章节介绍如何在系统中接入本地部署的 vLLM 模型 服务,用于快速完成模型注册与调用。

一、添加模型

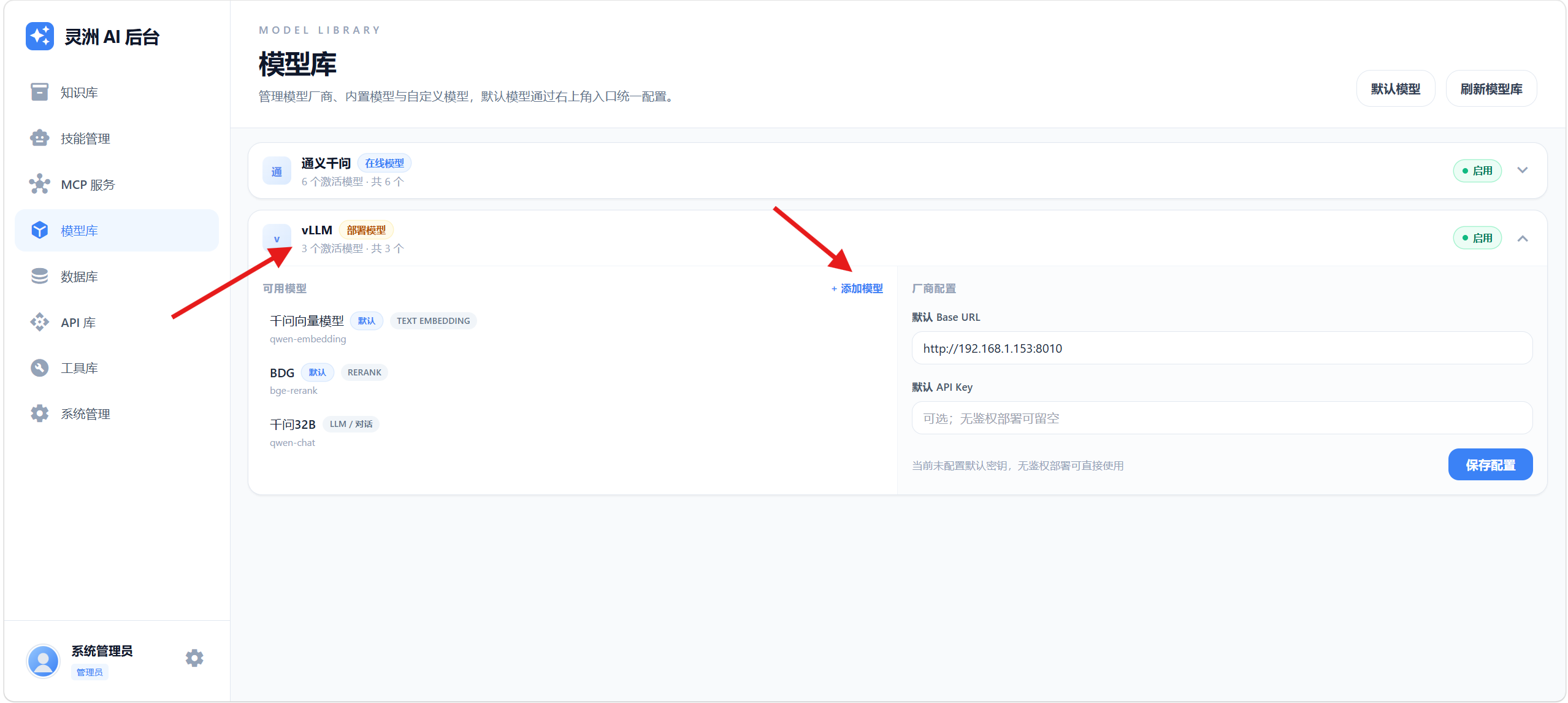

- 进入系统后台,打开

模型库页面 - 选择

vLLM类型 - 点击

添加模型

如下图所示:

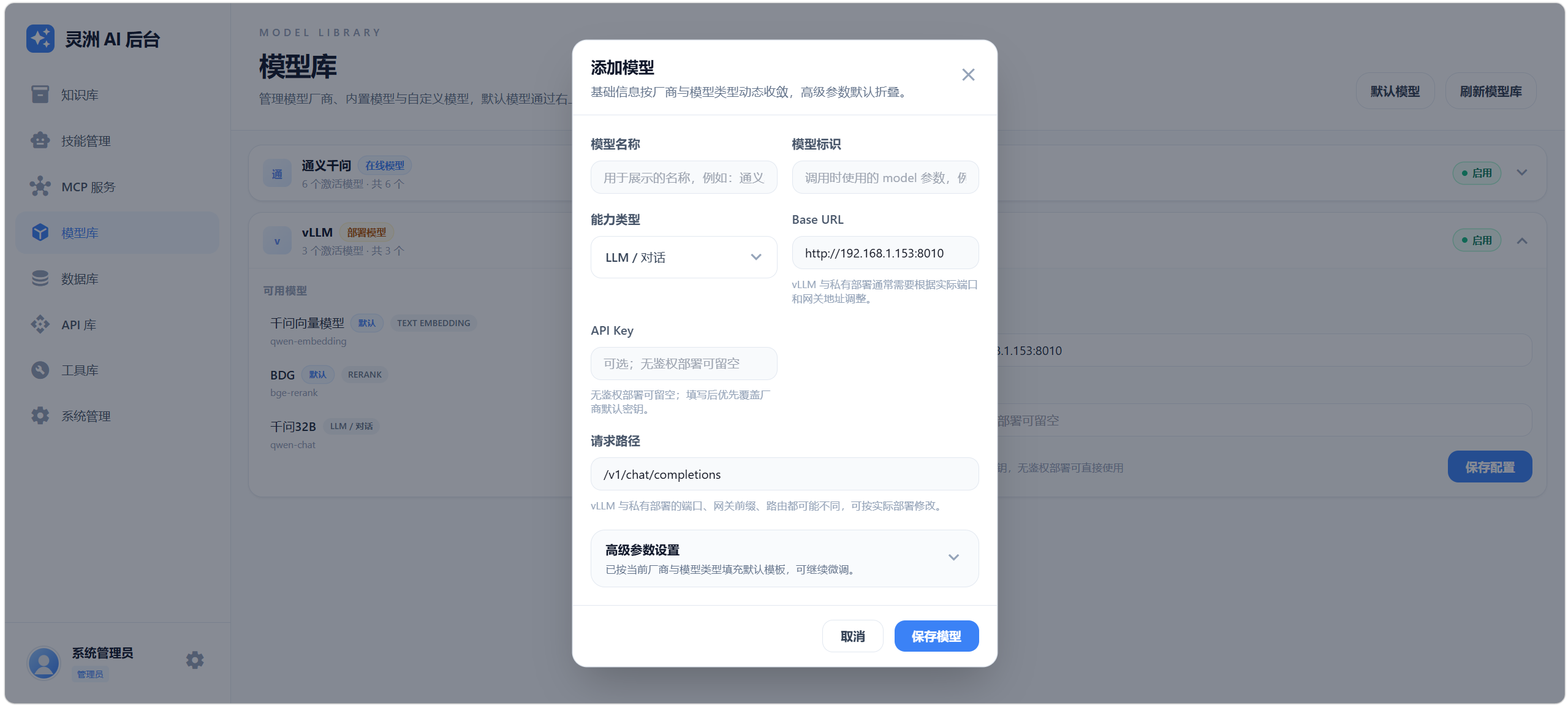

二、参数说明

在添加模型页面中,需要填写以下参数:

模型名称: 自定义填写,用于区分不同模型(建议使用易识别名称)模型标识: 必须与vLLM服务中返回的model字段 完全一致(否则无法正常调用)能力类型: 根据模型实际能力选择(如:对话 / 文本生成 / 多模态等)Base URL: vLLM 服务地址(例如:http://localhost:8000)API Key: 若服务未设置鉴权,可留空请求路径: 由系统自动获取,无需手动填写高级设置: 可选项,用于配置请求参数(如 temperature、max_tokens 等),如无特殊需求可保持默认

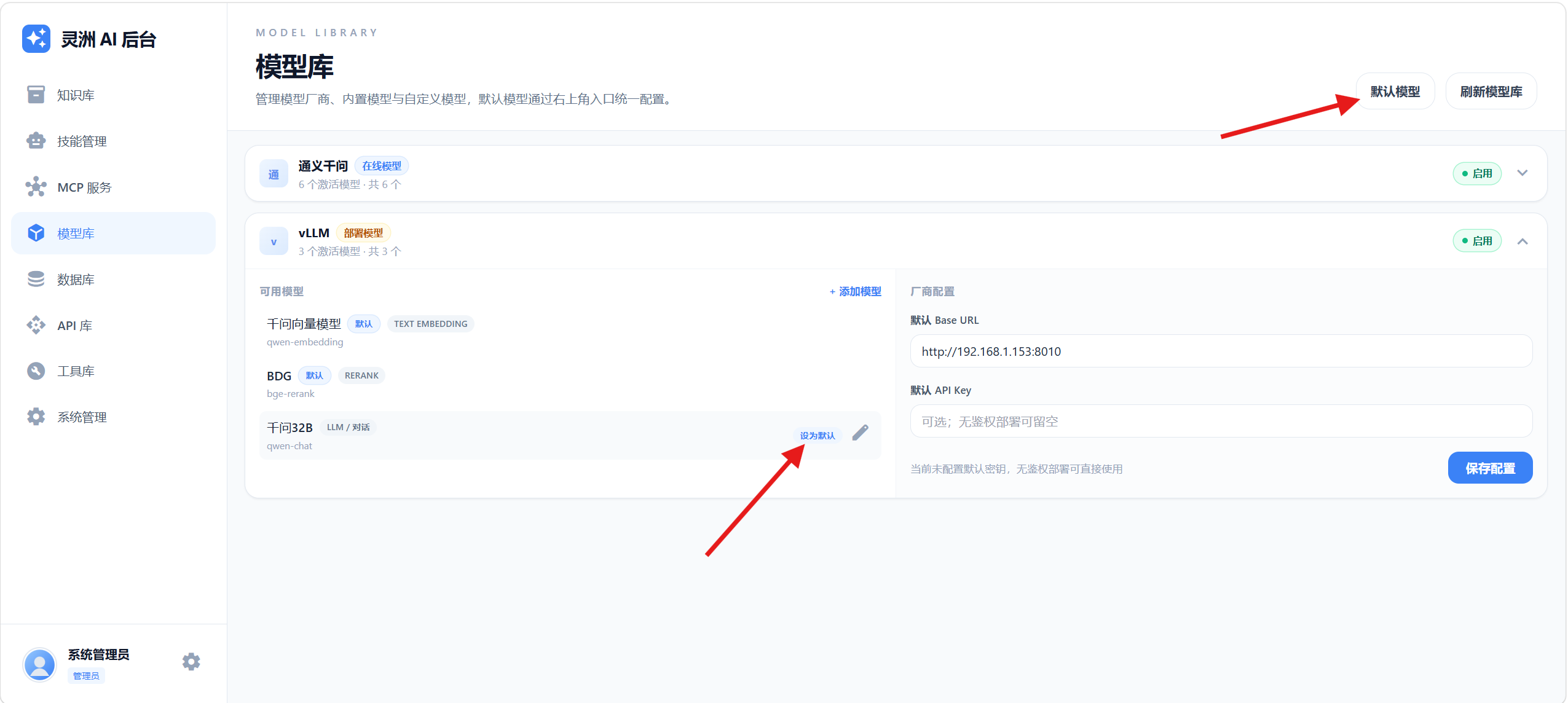

三、保存与启用模型

填写完成后:

- 点击右下角

保存模型 - 在模型列表中将该模型设为默认模型

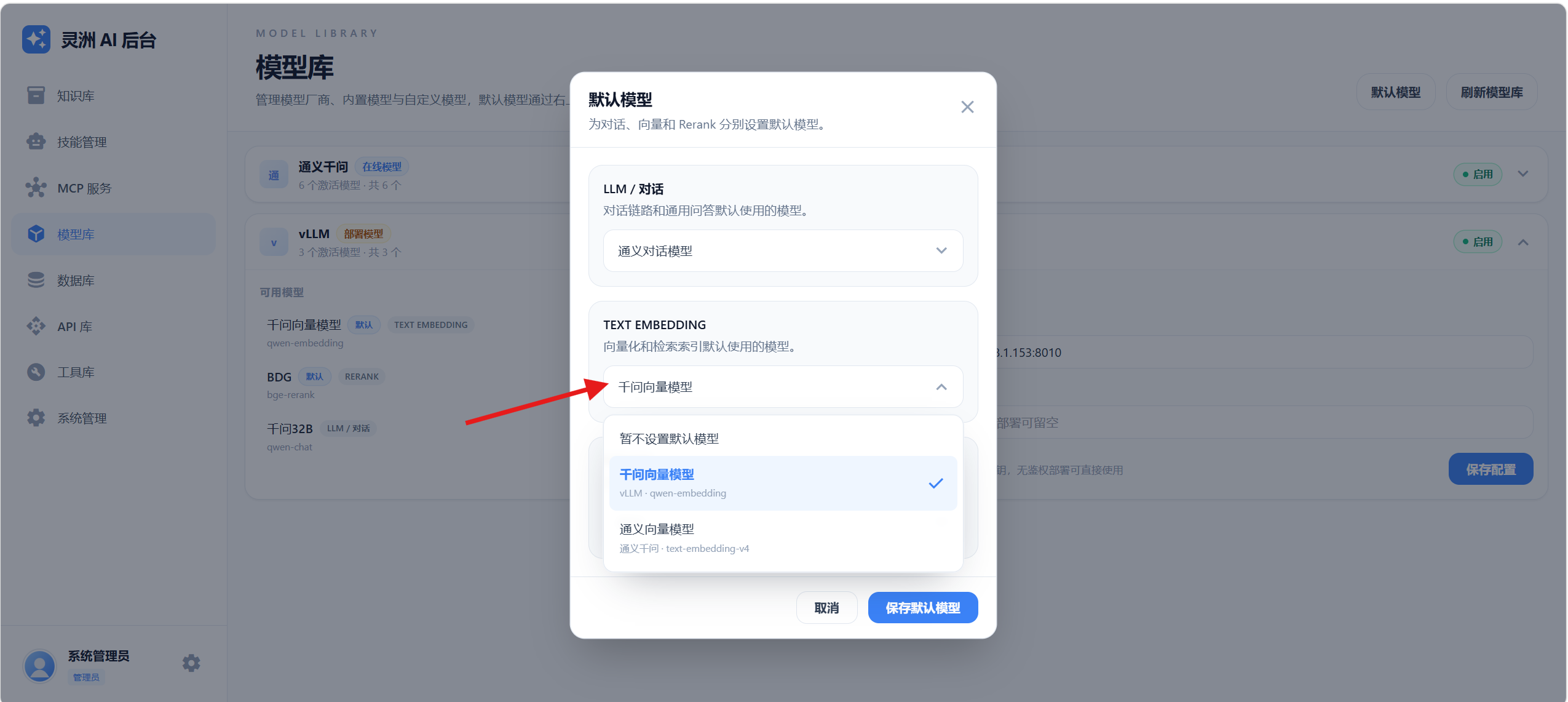

- 后续即可在

默认模型中选择并使用

如下图所示:

四、使用

配置完成后:

- 系统将默认使用选择的模型作为本地模型服务

- 可在 应用 中直接调用

五、注意事项

- 请确保

vLLM服务已正常启动,并且接口可访问 模型标识必须严格匹配,否则会出现调用失败- 若调用异常,可优先检查

Base URL和端口配置