模型搭建

本文介绍如何下载和启动本地模型

模型下载

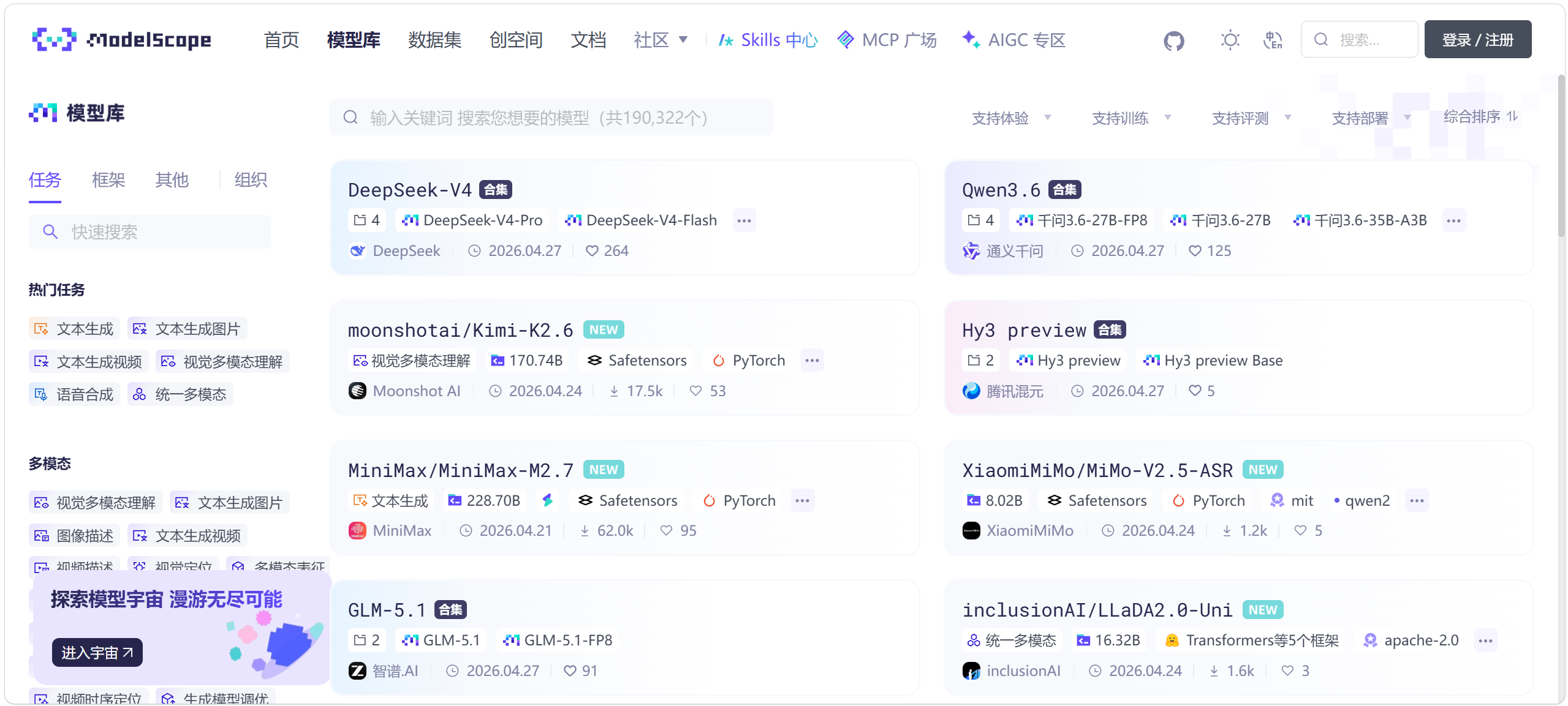

推荐从魔搭社区模型库下载所需模型

下载方式见魔搭社区 文档 → 模型的下载

模型启动

大语言模型

以启动 qwen3-vl-32b 作为示例:

VLLM_USE_V1=0 \

TORCH_COMPILE_DISABLE=1 \

VLLM_SOURCE_BROADCAST_TIMEOUT=600 \

nohup python3 -m vllm.entrypoints.openai.api_server \

--model /home/models/qwen3-vl-32b/ \

--served-model-name qwen-chat \

--tensor-parallel-size 4 \

--gpu-memory-utilization 0.8 \

--enable-auto-tool-choice \

--tool-call-parser hermes \

--port 8010 \

--host 0.0.0.0 \

--dtype bfloat16 \

--max-model-len 32768 \

--max-num-batched-tokens 16384 \

--limit-mm-per-prompt '{"image":2, "video":0}' \

--compilation_config '{"cudagraph_mode": "FULL_DECODE_ONLY", "level": 0}' \

--skip-mm-profiling > llm.log 2>&1 &

向量化模型

以启动 Qwen3-Embedding-0.6B 作为示例:

VLLM_USE_V1=0 TORCH_COMPILE_DISABLE=1 CUDA_VISIBLE_DEVICES=2 nohup python3 -m vllm.entrypoints.openai.api_server \

--model /home/models/Qwen3-Embedding-0.6B/ \

--served-model-name qwen-embedding \

--tensor-parallel-size 1 \

--max-model-len 4096 \

--gpu-memory-utilization 0.1 \

--enforce-eager \

--max-num-seqs 32 \

--port 8011 --host 0.0.0.0 > embed.log 2>&1 &

重排序模型启动

以启动 bge-reranker-v2-m3 作为示例:

CUDA_VISIBLE_DEVICES=3 nohup python3 -m vllm.entrypoints.openai.api_server --model /home/models/bge-reranker-v2-m3 --served-model-name bge-rerank --runner pooling --tensor-parallel-size 1 --max-model-len 4096 --gpu-memory-utilization 0.1 --max-num-seqs 10 --enforce-eager --port 8013 --host 0.0.0.0 > bge-rerank.log 2>&1 &